De plus en plus d’entreprises utilisent des chatbots pour répondre aux questions techniques de leurs clients ou utilisateurs. Ces outils permettent un gain de temps considérable pour les équipes de support et une meilleure réactivité pour les utilisateurs. Mais avec l’entrée en vigueur de l’AI Act européen, il est essentiel de s’assurer que ces assistants virtuels respectent les nouvelles obligations légales. Que signifie concrètement cette réglementation pour votre entreprise ? Et que faire si votre chatbot a été entraîné avec votre documentation technique et vos historiques de tickets support ?

1. L’AI Act en bref : une réglementation pour encadrer l’IA

Adopté par l’Union européenne, l’AI Act classe les systèmes d’intelligence artificielle selon leur niveau de risque. Certains usages sont interdits, d’autres (comme les chatbots) sont considérés comme à risque limité ou modéré. Cela implique des obligations de transparence et de surveillance. L’objectif est de protéger les utilisateurs tout en permettant l’innovation.

2. Mon chatbot est-il concerné ?

Oui, car même un simple chatbot entraîné avec votre documentation interne et vos tickets de support est considéré comme un système d’IA. L’AI Act impose aux entreprises de garantir que ces outils ne désorientent pas les utilisateurs, ne produisent pas de réponses trompeuses, et respectent les droits fondamentaux (notamment la protection des données).

3. Les obligations concrètes pour les chatbots

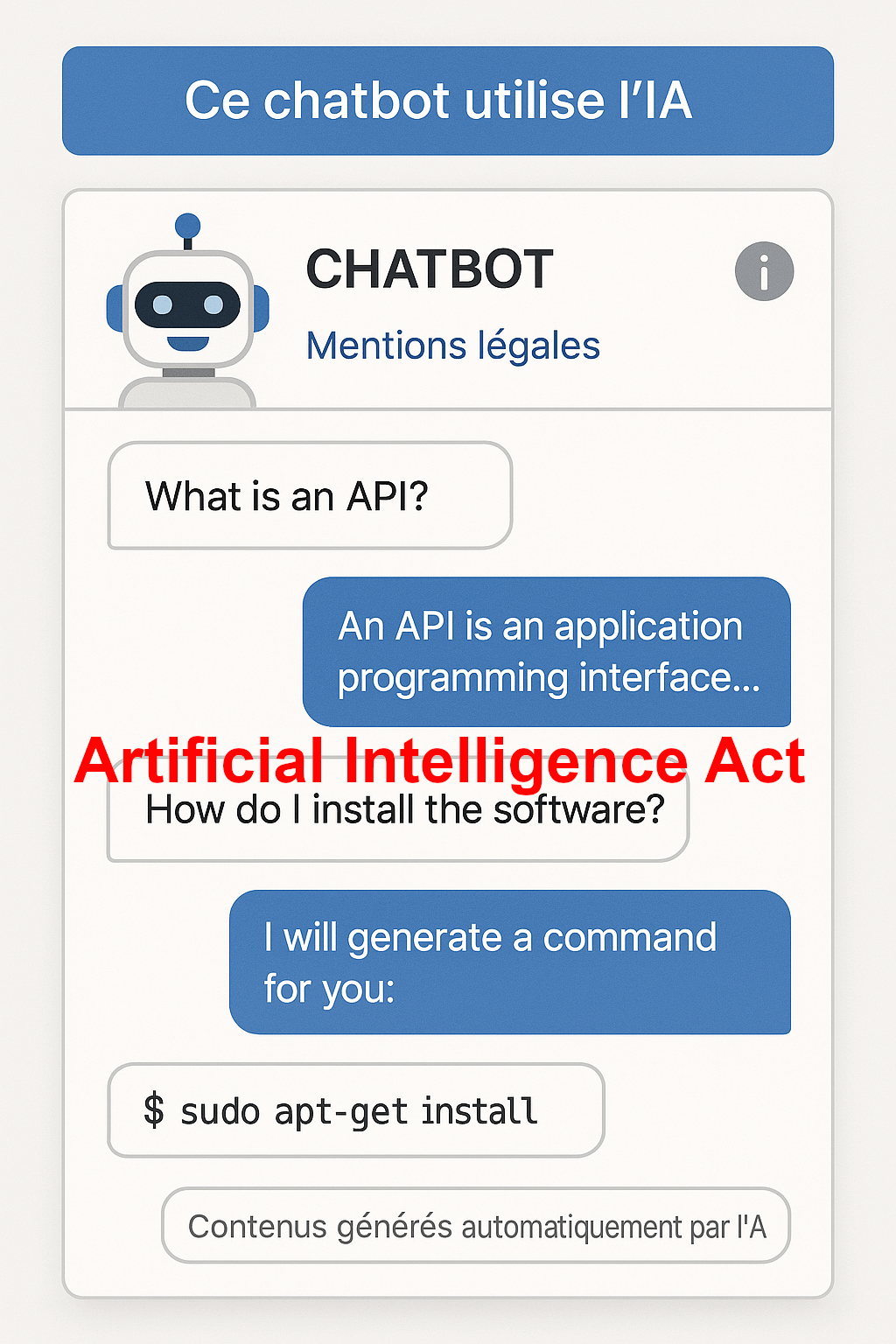

Voici ce que l’AI Act attend des entreprises qui utilisent des chatbots d’assistance :

- Informer l’utilisateur qu’il s’adresse à une IA, et non à un humain.

- Garantir la vérifiabilité des réponses : les réponses doivent reposer sur des sources fiables (dans votre cas, la documentation officielle de votre logiciel).

- Permettre un recours humain : si le chatbot ne répond pas correctement, l’utilisateur doit pouvoir contacter un humain facilement.

- Surveiller les biais et dérives : mettre en place un suivi pour détecter les réponses inappropriées ou discriminatoires.

- Protéger les données personnelles : si le chatbot utilise ou expose des données issues des tickets de support, ces données doivent être anonymisées.

4. Attention aux données saisies dans les tickets

Un risque souvent sous-estimé concerne les informations personnelles que les techniciens peuvent inscrire dans les tickets de support. Il est fréquent que des noms, prénoms, numéros de téléphone ou même des adresses e-mail y soient renseignés. Si ces tickets ont servi à entraîner le chatbot, ces données peuvent potentiellement être restituées par l’IA. C’est une violation du RGPD et une non-conformité à l’AI Act. Il est donc crucial d’anonymiser systématiquement les données avant de les intégrer à l’entraînement du chatbot.

5. Comment se mettre en conformité sans complexité

Pas besoin de tout repenser. Voici une feuille de route simple pour se conformer :

- Audit interne : identifiez quelles données ont servi à entraîner le chatbot, et vérifiez qu’elles respectent le RGPD.

- Mise à jour de l’interface : ajoutez un message clair signalant que l’utilisateur discute avec une IA.

- Supervision régulière : mettez en place une relecture périodique des réponses et une mécanique de remontée des erreurs.

- Documentation et journalisation : gardez une trace des améliorations apportées au chatbot et des cas litigieux traités.

Conclusion

Ce que cela change pour votre entreprise Mettre en conformité votre chatbot, ce n’est pas seulement une obligation réglementaire : c’est aussi une opportunité d’offrir une expérience utilisateur plus fiable et transparente. Pour IsiNeva et ses clients, cela signifie renforcer la confiance, tout en préservant la performance et la réactivité du support technique.

Liens externes

IA : la CNIL finalise ses recommandations : https://www.cnil.fr/fr/ia-finalisation-recommandations-developpement-des-systemes-ia

Résumé officiel de l’AI Act : https://digital-strategy.ec.europa.eu/en/policies/european-approach-artificial-intelligence